“AI換臉”以假亂真 務必保持防范意識

2023-07-13 中國質(zhì)量萬里行 點擊:次

點開直播間乍一看,賣貨的竟是當紅女星。再定睛一看,“明星”其實是使用人工智能(AI)實時換臉技術的普通主播……近期,“AI換臉”的應用范圍越來越廣,但存在濫用之嫌,甚至有人利用AI換臉實施犯罪,“AI詐騙正在全國爆發(fā)”沖上微博熱搜。

前不久,就有一男子因AI“換臉”,10分鐘被騙430萬元。如此以假亂真,讓人防不勝防。

老板遭遇換臉詐騙 10分鐘被騙430萬元

據(jù)“平安包頭”消息,內(nèi)蒙古自治區(qū)包頭市公安局電信網(wǎng)絡犯罪偵查局發(fā)布一起使用智能AI技術進行電信詐騙的案件。

來自福建的郭先生是一家科技公司的法人代表。今年4月,他的好友突然通過微信視頻聯(lián)系他,稱自己的朋友在外地競標,需要430萬元保證金,想借用郭先生公司的賬戶走賬。基于對好友的信任,加上已經(jīng)視頻聊天“核實”了身份,郭先生在10分鐘內(nèi),先后分兩筆把430萬元轉(zhuǎn)到了對方的銀行賬戶上。

漫畫:警惕AI換臉詐騙。中新社發(fā) 尹正義 攝

事后,郭先生撥打好友電話才得知被騙,原來騙子通過AI換臉和擬聲技術,佯裝好友對其實施詐騙。“當時是給我打了視頻的,我在視頻中也確認了面孔和聲音,所以才放松了戒備。”郭先生事后說。

揭秘“換臉”騙局 “雙刃劍”效應明顯

張嘴、搖頭,攝像頭捕捉到人的動作后,屏幕上原本靜態(tài)的人像可以動起來,動作幅度和真人一致,還能眨眼和露齒微笑,仿真度頗高,幾分鐘內(nèi)就能生成一段視頻,臉還能被任意替換。這就是“AI換臉”技術。

據(jù)了解,“AI換臉”背后采用的是深度合成技術,利用深度學習、虛擬現(xiàn)實等生成合成類算法,制作圖像、音頻、視頻等信息,目前在社交、影視、廣告、醫(yī)療等諸多領域不斷深化應用,有較大的技術價值和商用潛力,不過也存在著一定的安全隱患,“雙刃劍”效應明顯。

全聯(lián)并購公會信用管理委員會專家安光勇對表示,目前AI換臉技術主要通過深度學習和計算機視覺技術實現(xiàn)。它使用了深度神經(jīng)網(wǎng)絡來分析和識別視頻中的人臉,并將一個人的臉部特征映射到另一個人的臉上。

在微信視頻中,犯罪分子可能會通過發(fā)送特制的視頻或使用特定的換臉應用程序,將自己的臉替換為受害者的臉,以獲取對方的信任并實施詐騙行為。

AI換臉冒充明星帶貨 律師稱或涉嫌侵權

除了佯裝“熟人臉”實施詐騙,AI換臉還可能出現(xiàn)在直播帶貨中。最近,網(wǎng)上出現(xiàn)了一些“換臉直播”教程,教程發(fā)布者聲稱實時變臉軟件可以幫助用戶輕松“變臉”,極大地助力引流賣貨。

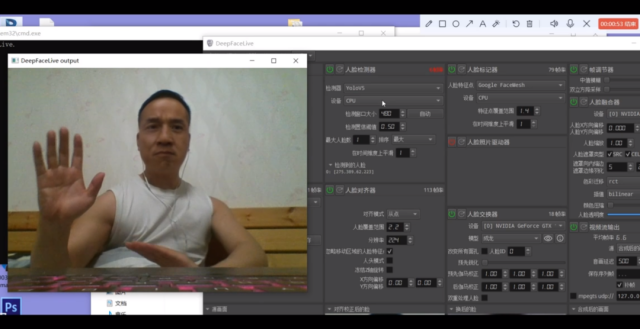

在一個展示換臉直播效果的視頻中,使用者把名為“成龍”的模型載入相關軟件后,攝像頭前的人在直播畫面中就有了與成龍相似的五官,但臉型和發(fā)型還保持原樣。

安光勇表示,換臉技術的成熟度隨著時間的推移在不斷提高,在某些情況下可以產(chǎn)生逼真的結果,但仍然存在一些瑕疵,比如細節(jié)不完美或者在某些情況下可能顯得不自然。記者發(fā)現(xiàn),使用者歪頭或變換表情時,五官動效切換得自然順滑,只有手掌從臉前劃過時,出現(xiàn)了比較明顯的破綻。

發(fā)布者展示換臉為“成龍”的實時效果和軟件界面(視頻截圖)

北京岳成律師事務所高級合伙人岳屾山表示,換臉直播用于公開傳播可能涉嫌侵犯相關明星藝人的肖像權。如果涉及直播帶貨等商業(yè)行為,會成為加重情節(jié)。

岳屾山解釋,只要未經(jīng)肖像權人同意,在直播中通過技術手段把自己的臉換成了明星的臉,就是對明星肖像的侵權。根據(jù)不同情況,承擔的后果可能不同。即便只是娛樂,不涉及盈利行為,也屬于侵權。如果把明星肖像用于帶貨直播,屬于是商業(yè)行為,在賠償數(shù)額上一定會給予考慮。如果主觀惡性、過錯程度比較大,且因此獲利,賠償數(shù)額可能會更高。

漫畫:“AI換臉”簡單好玩但有可能涉及侵權。中新社發(fā) 朱慧卿 攝

記者注意到,一些使用換臉技術的直播并不會直接提到相關明星藝人的名字,但也不會主動聲明或者否認。岳屾山認為,該行為涉嫌欺詐或是虛假宣傳,讓公眾誤以為就是明星在帶貨。如果貨品本身質(zhì)量不好,或者主播在帶貨過程中說的話或行為導致公眾對被換臉的明星產(chǎn)生負面評價,明星可以主張名譽權的侵權責任。

AI技術存在濫用風險 務必保持防范意識

為規(guī)范人工智能發(fā)展,去年12月,《互聯(lián)網(wǎng)信息服務深度合成管理規(guī)定》正式發(fā)布,明確了合成數(shù)據(jù)和技術管理規(guī)范。其中提到:深度合成服務提供者對使用其服務生成或編輯的信息內(nèi)容,應當添加不影響使用的標識。提供智能對話、合成人聲、人臉生成、沉浸式擬真場景等生成或者顯著改變信息內(nèi)容功能的服務的,應當進行顯著標識,避免公眾混淆或者誤認。

近期,也有平臺和企業(yè)發(fā)布了“關于人工智能生成內(nèi)容的平臺規(guī)范暨行業(yè)倡議”,明確禁止利用生成式人工智能技術創(chuàng)作、發(fā)布侵權內(nèi)容,包括但不限于肖像權、知識產(chǎn)權等,一經(jīng)發(fā)現(xiàn),平臺將嚴格處罰。

對于個人而言,除了在形形色色的“明星臉”中保持清醒,避免陷入虛假宣傳,更重要的是面對花樣翻新的AI詐騙,必須保持防范意識。

中國質(zhì)量萬里行提醒,涉及資金轉(zhuǎn)賬時,公眾要提高安全意識,通過見面、電話等多種方式核驗對方身份;可將轉(zhuǎn)賬到賬時間設定為“24小時到賬”,以預留處理時間;針對支付軟件以及網(wǎng)銀軟件,要使用多種登錄及轉(zhuǎn)賬驗證方式。

針對花樣翻新的智能AI詐騙,要提高防范意識,謹慎使用各類“AI換臉”“AI變聲”軟件;加強個人信息保護意識,避免注冊不需要的賬號、填寫不必要的個人信息,以防個人信息泄露;對不斷更新的網(wǎng)絡技術和詐騙方式,堅持不輕信、不透露、不點擊、不轉(zhuǎn)賬。

如不慎被騙或遇可疑情形,請注意保護證據(jù),并立即撥打96110報警。

掃碼投訴

京公網(wǎng)安備11010502034432號

京公網(wǎng)安備11010502034432號